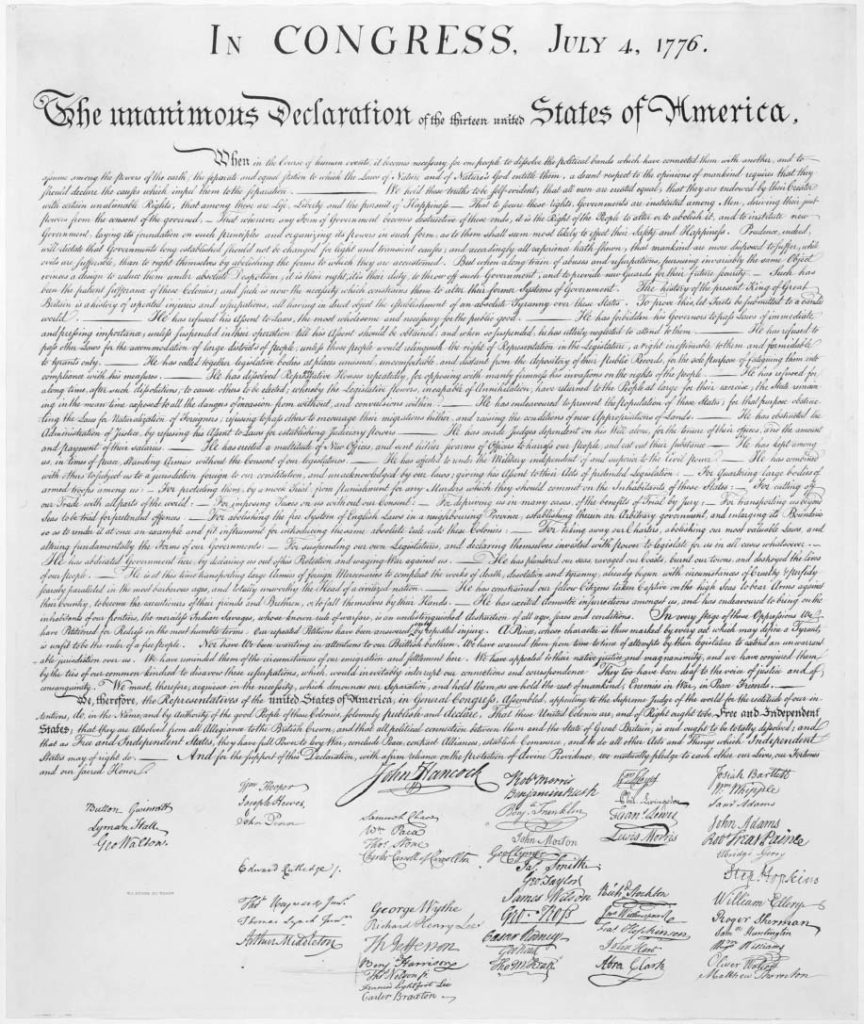

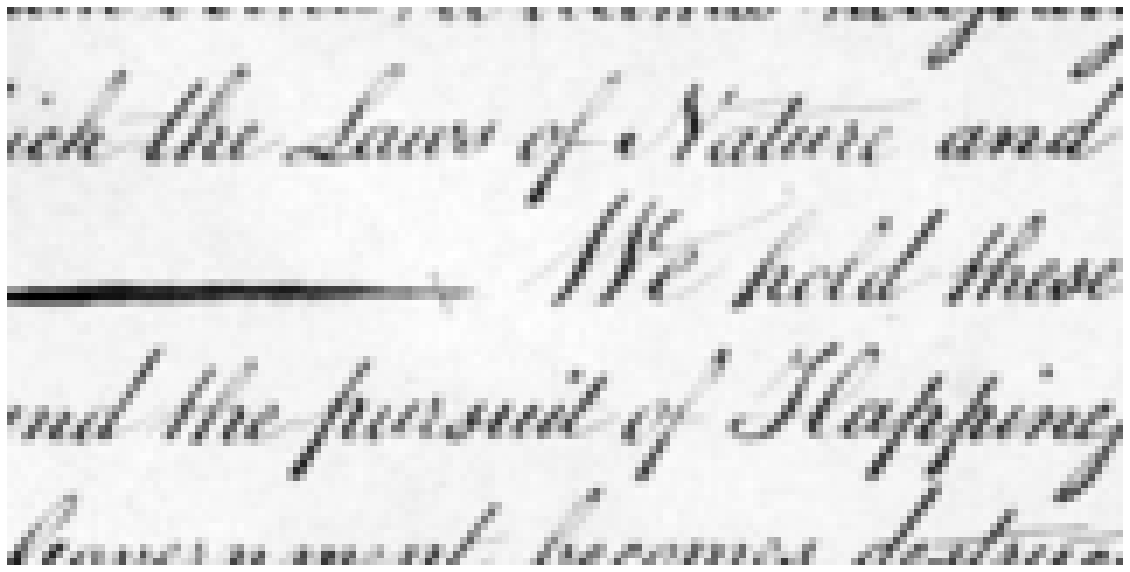

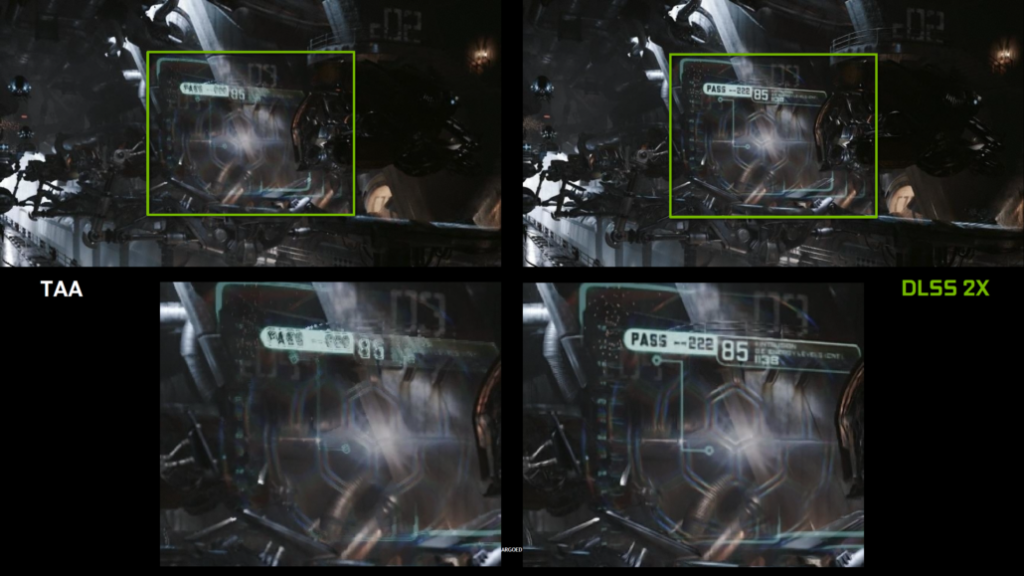

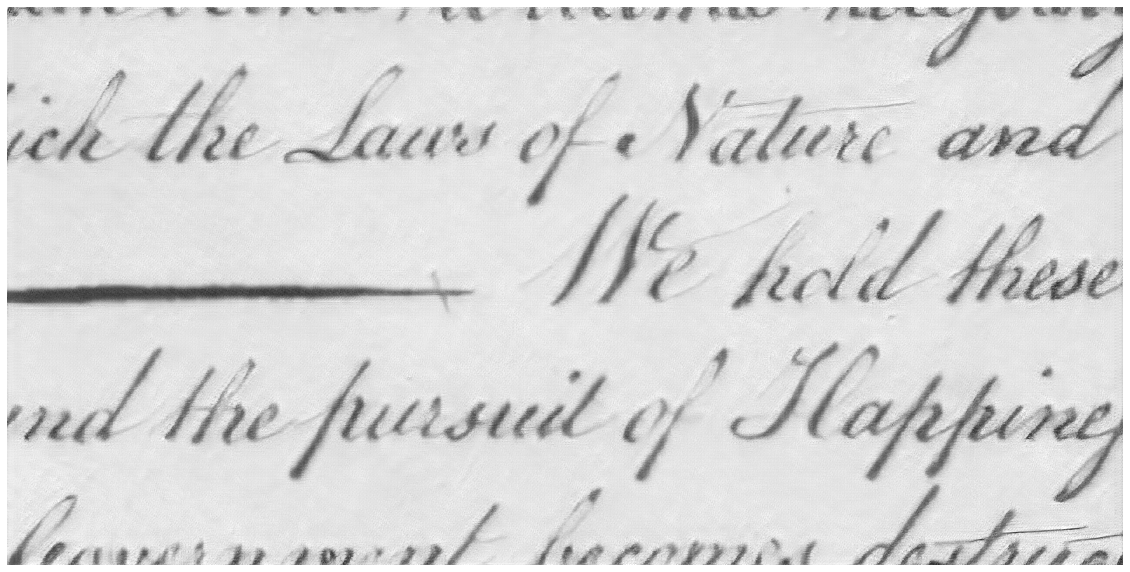

Leider hat der Prozess der Hochskalierung von Echtzeit-Computergrafiken gewisse Vorteile. Zum Beispiel hat man in der Regel mehrere Bilder in einer Sequenz, aus denen man zusätzliche Informationen extrahieren kann, die in Einzelbildern verloren gehen können. Man kann auch zusätzliche Informationen verwenden, die von der Rendering-Engine zur Verfügung gestellt werden, wie Bewegungsvektoren oder sogar Objektschablonen. Wenn wir mit gescannten Seiten alter Dokumente arbeiten, haben wir nichts von alledem. Wir haben nur ein Bild, und wir müssen uns jede Art von Zusatzinformationen "einbilden". Glücklicherweise ist dies ein Bereich wo sich AI hervorgetan hat auch. Dieser spezielle Teilbereich hat sich mit so genannten Generative Adversarial Networks, und obwohl sie noch nicht wirklich in Produktionsumgebungen eingesetzt werden, zeigen sie bemerkenswertes Potenzial. Sie arbeiten mit zwei separaten neuronalen Netzwerken: Einen Generator und einen Diskriminator. Im häufigsten Anwendungsfall erzeugt der Generator neue Bilder, während der Diskriminator versucht, gefälschte Bilder unter den echten aus einem gegebenen Trainingsdatensatz zu erkennen. Der Trainingsprozess ist ein Nullsummenspiel, bei dem ein Netzwerk besser darin wird, Bilder zu fälschen, während das andere besser darin wird, Fälschungen zu erkennen. Wenn sie lange genug trainiert werden, können GANs nachweislich folgende Ergebnisse erzielen fotorealistische Ergebnisse. Wenn wir völlig neue Bilder erstellen möchten, würden wir im Wesentlichen Zufallsdaten als Eingaben in den Generator einspeisen. Das ist für Künstler oder Content-Ersteller sehr interessant, aber wir wollen eigentlich die vorhanden Bilder. Dazu benötigen wir einen leicht modifizierten Aufbau, für den wir uns die in diesem Beitrag beschriebene Architektur genauer angeschaut haben: Fotorealistische Einzelbild-Super-Resolution mit einem generativen Adversarial-Netz. Die Details sind ein bisschen zu kompliziert für diesen Beitrag, aber die Ergebnisse sprechen für sich selbst.